CNews, l’IA et l’effondrement de la vérification : quand le média devient complice de la manipulation

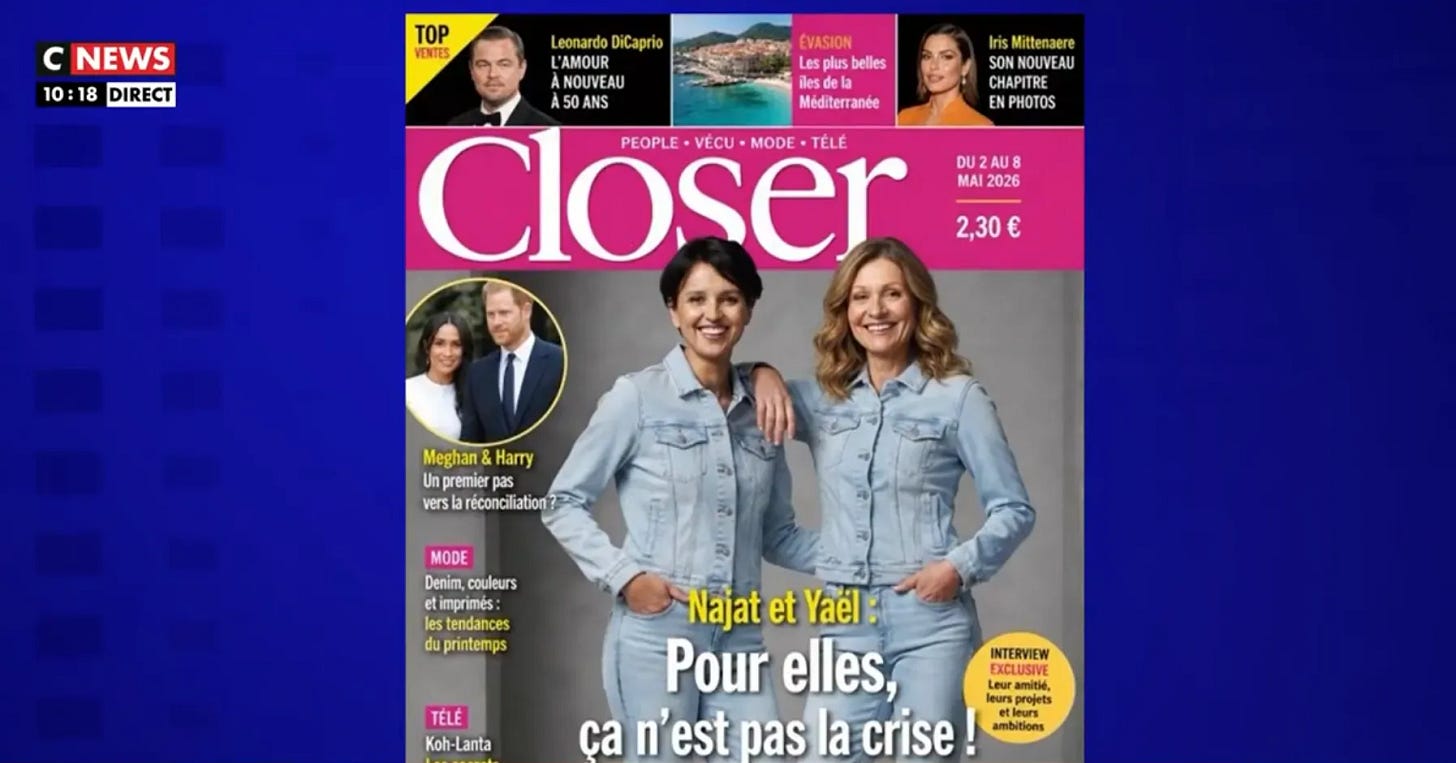

Le 4 mai 2026, CNews a diffusé en direct une fausse couverture de Closer générée par IA. Au-delà de l’erreur, c’est l’abdication de son rôle de garde-fou qui choque.

Car oui, l’IA produit déjà des images réalistes, et oui, des États ou des acteurs malveillants l’utilisent pour manipuler. Mais un média, lui, a pour mission de vérifier. Or, ici, CNews a échoué sur toute la ligne.

Le 4 mai 2026, dans l’émission L’Heure des Pros, Pascal Praud présente comme authentique une couverture du magazine Closer montrant Yaël Braun-Pivet et Najat Vallaud-Belkacem en tenue décontractée, souriantes, avec le titre « Najat et Yaël : Pour elles, ça n’est pas la crise ! ». Problème : cette Une n’a jamais existé. Elle a été générée par intelligence artificielle. Pourtant, le présentateur vedette de CNews l’a commentée en direct, sans la moindre vérification préalable, avant de se rétracter sous la pression des réactions indignées.

Ce n’est pas une simple erreur. C’est un symptôme. Celui d’une chaîne qui, sous couvert de « débat » et de « liberté d’expression », a abdiqué son devoir de rigueur au profit du buzz et de la polarisation. Alors que l’IA permet déjà de créer des images hyperréalistes et que des États étrangers l’utilisent pour manipuler l’opinion, les médias, eux, doivent rester des remparts. Or, dans cette affaire, CNews a devenu complice de la désinformation.

En résumé : 3 points clés

Un deepfake non vérifié : Pascal Praud a diffusé en direct une couverture de Closer générée par IA, associant Yaël Braun-Pivet et Najat Vallaud-Belkacem en jean, avec un titre ironique sur leur prétendu détachement face à la crise sociale.

Une chaîne en défaut de rigueur : Aucune vérification préalable n’a été effectuée avant la diffusion, malgré l’existence d’outils pour détecter les deepfakes. Pascal Praud a bien rectifié en direct quelques minutes plus tard, mais après que des conclusions politiques aient déjà été tirées, ce qui ne suffit pas à effacer l’impact de la désinformation.

Un symptôme systémique : L’incident révèle une culture de l’immédiateté et de la polarisation chez CNews, où la vérification passe après le buzz, au mépris de l’éthique journalistique.

Les faits

L’IA, une menace connue mais sous-estimée par CNews

Les deepfakes ne sont plus un futurist lointain. Des États comme la Russie, la Chine ou l’Iran les utilisent déjà pour déstabiliser l’opinion publique ou discréditer des opposants. Les outils d’IA générative (Midjourney, Stable Diffusion, etc.) permettent aujourd’hui de créer des images ou des vidéos indétectables à l’œil nu pour le grand public. Pourtant, des solutions existent pour limiter les risques :

Des logiciels de détection (comme Microsoft Video Authenticator ou Deepware Scanner) permettent d’identifier les artefacts numériques.

Des protocoles de vérification (croiser les sources, contacter les personnes concernées, analyser les métadonnées) sont des réflexes de base pour tout journaliste sérieux.

Alors, pourquoi CNews a-t-elle ignoré ces précautions ?

La réponse tient en trois mots : pression du direct, biais de confirmation, culture de l’impunité.

Dans l’émission L’Heure des Pros, chaque seconde compte. L’immédiateté et le clash sont les maîtres-mots pour capter l’audience. Vérifier prend du temps, et du temps, c’est de l’audience en moins. De plus, la fausse couverture de Closer correspondait à un narratif déjà ancré chez CNews : celui d’une élite politique déconnectée, prête à tout pour sauver les apparences. Pourquoi vérifier quand l’image colle parfaitement au récit que l’on veut vendre ? CNews, dont la ligne éditoriale est ancrée à droite, voire à l’extrême droite selon plusieurs analyses et propriété du milliardaire conservateur Vincent Bolloré, a rarement été sanctionnée pour ses dérives malgré ses biais politiques marqués et son manque de pluralisme. Résultat : l’auto-discipline se relâche.

La réaction des acteurs : trop peu, trop tard

Yaël Braun-Pivet a réagi avec fermeté, soulignant que « la frontière entre le vrai et le faux n’a jamais été aussi fragile » et que « informer, c’est vérifier ». Elle a saisi l’Arcom, le régulateur de l’audiovisuel, pour manquement à l’obligation de rigueur.

Pascal Praud, de son côté, a reconnu son erreur sur X, évoquant un « mea culpa » et une « rectification en direct ». Mais cette réaction arrive après que le plateau ait déjà tiré des « conclusions politiques » de l’image falsifiée, comme l’a noté Braun-Pivet elle-même. L’un des chroniqueurs a ainsi suggéré que Braun-Pivet « joue la gauche » pour se donner une image plus consensuelle, alors que l’image était un pur artefact numérique.

Le problème ? La rectification ne répare pas le mal causé. Une fois l’image diffusée, le mensonge a déjà fait son chemin. Et dans un contexte de défiance généralisée envers les médias, chaque erreur de ce type alimente la théorie du complot : « Si CNews ment sur ça, pourquoi pas sur le reste ? »

Confrontation des versions : ce que dit CNews vs. ce que montrent les faits

Dans sa défense, CNews avance que Pascal Praud a « bien sûr » cru à l’authenticité de la Une, et que la chaîne a « rectifié en direct ». Pourtant, les faits sont têtus :

L’image était bel et bien générée par IA, comme l’a confirmé Braun-Pivet et comme le montrent les analyses ultérieures.

La rectification est intervenue après que des conclusions politiques aient été tirées sur le plateau.

Il est difficile de croire à une « erreur isolée » quand on connaît l’historique de CNews, déjà critiquée pour son traitement partiel de l’actualité et son manque de pluralisme, comme le soulignent régulièrement des observateurs des médias.

Analyse :

1. Le rôle des médias : vérifier ou périr

Un média a une responsabilité sacrée : dire la vérité, ou à défaut, ne pas mentir. Or, avec l’IA, le risque de manipulation explose. Trois obligations s’imposent aux médias, surtout dans un contexte de désinformation galopante :

Vérifier systématiquement : Toute image ou vidéo suspecte doit être soumise à des outils de détection avant diffusion. Les logiciels existent, les protocoles aussi. Il n’y a aucune excuse pour ne pas les utiliser.

Assumer ses erreurs de manière transparente : Une rectification ne suffit pas. Il faut expliquer comment l’erreur a pu se produire, présenter des excuses claires au public, et garantir que cela ne se reproduira pas. Or, CNews s’est contentée d’un « mea culpa » vague, sans analyse approfondie de ses dysfonctionnements.

Éduquer le public : Les médias doivent sensibiliser leurs audiences aux deepfakes et aux manipulations, plutôt que de les exploiter pour faire de l’audience.

CNews a échoué sur les trois points. Pire : en diffusant un deepfake sans vérification, la chaîne est devenue complice de la désinformation qu’elle prétendait combattre.

2. La droitisation des médias et le rejet des normes déontologiques

CNews incarne une dérive dangereuse, symptomatique d’une partie des médias français :

L’alignement sur le pouvoir : La chaîne a souvent été accusée de relayer des narratives partisanes plutôt que de les questionner. Dans ce cas précis, la fausse couverture de Closer s’inscrivait parfaitement dans le récit d’une élite politique déconnectée, ce qui a pu encourager une vérification minimaliste.

Le mépris des règles déontologiques : Que ce soit sur la vérification des faits, le respect du pluralisme ou la déontologie journalistique, CNews semble considérer que les règles ne s’appliquent pas à elle. Or, c’est précisément ce genre d’attitude qui sape la crédibilité de l’ensemble de la profession.

L’exemple qui tue : Si un média aussi influent normalise la diffusion de deepfakes, que peuvent faire les autres ? La course au sensationnalisme l’emporte sur l’éthique, et c’est toute la démocratie qui en pâtit.

3. Les conséquences pour la démocratie et la confiance dans les médias

Érosion de la confiance : Chaque fake news non démentie affaiblit la crédibilité de toute la presse. Quand un média comme CNews triche, c’est tous les journalistes qui en paient le prix. Les citoyens, déjà méfiants, auront encore plus de mal à distinguer le vrai du faux.

Polarisation accrue : Les deepfakes sont des armes de division. En les relayant, même involontairement, CNews alimente les tensions politiques et sociales, plutôt que de les apaiser. Dans un pays déjà fracturé, c’est une responsabilité lourde.

Un précédent inquiétant : Si l’Arcom ne sanctionne pas CNews pour cet incident, qui empêchera demain un autre média de faire de même ? La régulation doit montrer les dents, sous peine de voir la désinformation devenir la norme. Sans cela, les médias risquent de perdre leur rôle de contre-pouvoir pour devenir de simples caisses de résonance des manipulations.

Question :

Dans un monde où l’IA permet de fabriquer des réalités alternatives, les médias doivent-ils devenir des remparts contre la manipulation… ou risquent-ils de se transformer en ses principaux vecteurs ?

La réponse dépendra de leur capacité à assumer leur rôle de garde-fou, ou à disparaître, remplacés par des algorithmes encore moins scrupuleux qu’eux.